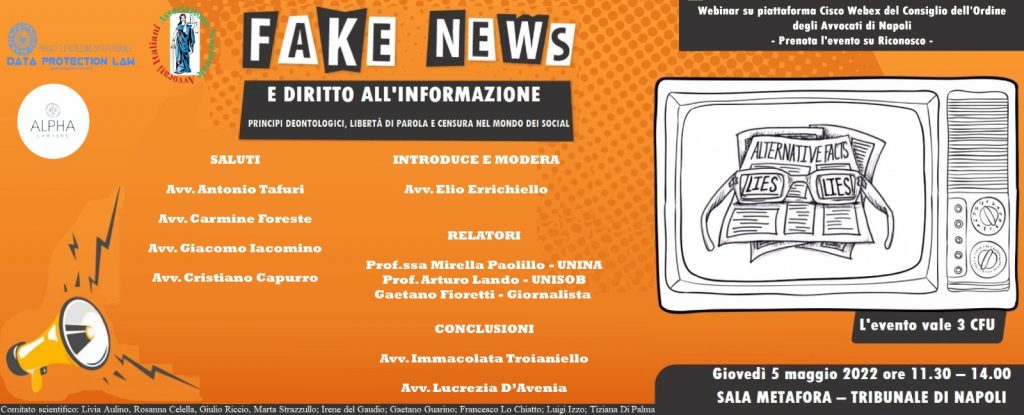

La disinformazione online è il tema del convegno in programma domani al Tribunale di Napoli, organizzato dalla nostra associazione in collaborazione con Anai Napoli, cui è possibile partecipare prenotandosi QUI.

Proviamo a fare un quadro su alcuni degli argomenti che saranno trattati in questo articolo.

Cosa sono le fake news e come riconoscerle?

La traduzione letterale del termine inglese fake news ricalca, come è noto, il concetto di notizie false, riferendosi ad articoli o pubblicazioni diffusi in particolare sul web, redatti con informazioni inventate, ingannevoli o distorte, quasi sempre allo scopo di disinformare oppure di attirare click su Internet (c.d. “click baiting”).

Il fenomeno trova le sue radici nel passato e uno dei primi esempi noti alla storia riguarda la diffusione della finta morte di Napoleone[1], notizia che mandò in tilt la borsa di Londra.

Nella Società dell’Informazione[2] le notizia bufala sono veicolate dai mezzi di comunicazione di massa (emittenti televisive e testate giornalistiche) ed è evidente come con l’avvento di Internet, soprattutto grazie alla condivisione sui social media, la loro diffusione sia aumentata a dismisura tanto da creare allarmismo su un fenomeno in realtà esistito da sempre.

Claire Wardle, una delle principali esperte del tema, nonché co-fondatrice e direttrice di ‘First Draft’, la più importante organizzazione no-profit al mondo finalizzata allo studio e al contrasto al fenomeno della disinformazione, ha individuato sette tipologie di notizie bufala, stilando così una sorta di grammatica delle fake news:

- contenuto ingannevole: quando titoli, immagini o didascalie differiscono dal contenuto vero e proprio della notizia;

- contenuto ingannatore: quando il contenuto viene spacciato come proveniente da fonti reali e veritiere, ma invece non è accurato e certo;

- contenuto falso: quando il contenuto è completamente falso, costruito appositamente per trarre in inganno;

- contenuto manipolato: quando si parte da un’informazione reale, per poi manipolarla al fine di trarre in inganno;

- contenuto fuorviante: quando si fa un uso ingannevole dell’informazione allo scopo di fuorviare una persona e/o eludere un problema;

- contesto ingannevole: quando il contenuto è reale, ma accompagnato da informazioni contestuali false;

- uso manipolatorio della satira: quando non c’è intenzione di procurare danno, ma il contenuto satirico viene utilizzato per trarre in inganno.

L’esperta prova a spiegare altresì le possibili motivazioni per cui questi contenuti vengono prodotti: propaganda, profitto, influenza politica, interesse particolare, faziosità, cattivo giornalismo, parodia, provocare o prendere in giro.

Sul punto, anche la giornalista Margareth Sullivan, in un articolo sul ‘The Washington Post’, ha condiviso alcuni consigli per poter riconoscere una fake new:

- Consultare e confrontare più fonti di informazione e vagliarne l’attendibilità.

- Non condividere/diffondere notizie senza aver prima verificato la veridicità delle stesse.

- Se siamo consci di aver diffuso o che si stia diffondendo un contenuto falso, cerchiamo di correggere le affermazioni velocemente.

- Avere un atteggiamento scettico verso l’informazione, non dare sempre tutto per certo e assodato, ma mettere in discussione ciò che si apprende e approfondire sempre.

- Usare il pensiero critico.

La responsabilità da fake news e disinformazione online

La possibilità fornita dalla rete di pubblicare il proprio pensiero sui più disparati temi, ovvero condividere informazioni e notizie, ha permesso il proliferare della conoscenza e del confronto tra utenti; parimenti, l’utilizzo scorretto delle piattaforme ha provocato il dilagare di contenuti non verificati e/o verificabili, con crescente preoccupazione per gli effetti distorsivi di una disinformazione su larga scala.

La velocità e la portata del fenomeno ha reso sin da subito evidente la difficile applicazione delle disposizioni in tema di responsabilità già vigenti, ad esempio, con riferimento alla stampa, come emerge da recenti pronunce della Suprema Corte a Sezioni Unite, sia in sede penale, sia in sede civile, dalle quali emergono criticità rispetto al rapporto tra la responsabilità personale e l’anonimato di cui possono abusare i net-surfers (v. Cass. pen., sez. un., n. 31022/2015; Cass. civ., sez. un., n. 23469/2016).

Per tale ragione, la discussione sul tema della responsabilizzazione ha puntato l’attenzione sui proprietari di siti e/o piattaforme social, i quali hanno la facoltà di gestire (o meglio, oscurare) direttamente i contenuti ritenuti illeciti (come accade, ad esempio, per il contrasto alla condivisione illecita di contenuti protetti da diritto d’autore). Il risultato però potrebbe rivelarsi quello di veder censurati preventivamente i contenuti che potrebbero mettere in pericolo la sopravvivenza o la reputazione delle piattaforme social.

Un esempio di detta inclinazione è fornito dalla sentenza della Corte europea dei diritti dell’Uomo (CEDU) nel caso Delfi AS c. Estonia (richiesta n. 64569/09), con la quale veniva pronunciata la non violazione dell’art. 10 (sulla libertà di espressione) della Convenzione europea dei diritti dell’uomo.

Il caso in commento è stato infatti il primo caso in cui la CEDU ha esaminato un ricorso in materia di responsabilità di un portale Internet di attualità, con riferimento a commenti pubblicati dai suoi utenti. La società richiedente, Delfi AS, che gestisce un portale di attualità a titolo commerciale, ha proposto ricorso sul fatto che le giurisdizioni nazionali l’avessero giudicata responsabile di commenti offensivi condivisi dai suoi visitatori in calce ad uno degli articoli presenti online, relativo una compagnia di navigazione. A seguito della richiesta degli avvocati della compagnia di navigazione, infatti, Delfi AS aveva prontamente oscurato i commenti ritenuti offensivi dalla società.

Detta pronuncia, risalente al 2014, evidenzia il rapporto tra la condotta degli utenti e le responsabilità di quelle piattaforme social che forniscono – a fini commerciali – uno spazio destinato alla pubblicazione di informazioni e commenti di utenti, i quali – anche in forma anonima – approfittano della facoltà concessa per pubblicare frasi chiaramente illecite ed in violazione dei diritti della personalità di terzi.

In tale scenario, è risultato necessario tentare di arginare il fenomeno, chiedendo la collaborazione direttamente alle Big Tech alle quali è stato chiesto di agire virtuosamente, creando autoregolamentazioni e sensibilizzando i propri utenti ad un uso più consapevole delle piattaforme. Detto impulso è emerso con maggiore vigore durante la presidenza US di Trump (culminata nell’assalto a Capitol Hill)[3] e la pandemia da Covid-19, e risulta quantomai attuale alla luce della crisi russo-ucraina, culminata nel conflitto armato avviato nel febbraio 2022.

La lotta delle Big Tech alla disinformazione online e il contributo degli utenti

Le azioni intraprese dalle grandi piatteforme a sostegno della diffusione di una sana e corretta informazione sono state molteplici, specie negli ultimi anni, in cui la disinformazione ha portato – o avrebbe potuto portare – conseguenze ancora più devastanti, in un mondo già dilaniato dalla pandemia e ora anche dalla guerra. La Commissione europea ha pubblicato infatti le relazioni di Google, Facebook, Microsoft, TikTok e Twitter sulle misure adottate nel novembre e nel dicembre 2021 contro la disinformazione sul coronavirus, in qualità di firmatari del codice di buone pratiche sulla disinformazione. Inoltre, le Big Tech sono impegnate in un elaborato lavoro con la Commissione europea, teso a definire “misure urgenti” da inserire nel codice di condotta contro la disinformazione “senza precedenti” sulla guerra in Ucraina.

A ciò deve aggiungersi l’accordo sul Digital Services Act, che impone alle Big Tech maggiore responsabilità sui contenuti illegali o fake che circolano sulle loro piattaforme.

Le piattaforme si sono impegnate a vigilare sui contenuti falsi o illegali diffusi per il loro tramite, dimostrando alto senso di dovere e responsabilità sociale; in questo modo i principali mezzi di diffusione della disinformazione diventano potenti strumenti di contrasto alla stessa.

Conclusioni: l’impegno contro la disinformazione online

Alla luce di quanto esposto, risulta evidente che al lavoro globale di istituzioni e grandi piattaforme deve accompagnarsi l’impegno di ciascun utente che, attraverso buon senso, pensiero critico e razionalità, deve essere in grado di discernere, selezionare e giudicare le innumerevoli informazioni che oggi la rete offre, garantendo sì una conoscenza potenzialmente illimitata, ma che va dal singolo accuratamente filtrata, nonché utilizzata nel modo giusto, sia per quel che concerne le informazioni apprese dai social media, sia quelle che gli stessi utenti condividono online.

Dunque, la responsabilità ed il dovere sociale dovranno essere avvertiti in primis dagli utenti.

Rosanna Celella e Giulio Riccio

[1] https://www.wired.it/play/cultura/2017/07/28/napoleone-morto-fake-news-borsa-londra/

[2] S. CRAWFORD, The Origin and Development of a Concept: The Information Society, 1983, Bull. Med. Libr. Assoc. 71(4) October, 380

[3] G. Riccio, Democrazia 2.0: Libertà di Espressione ed Internet, 2021, consultabile al link http://www.giulioriccio.com/democrazia-ed-internet/